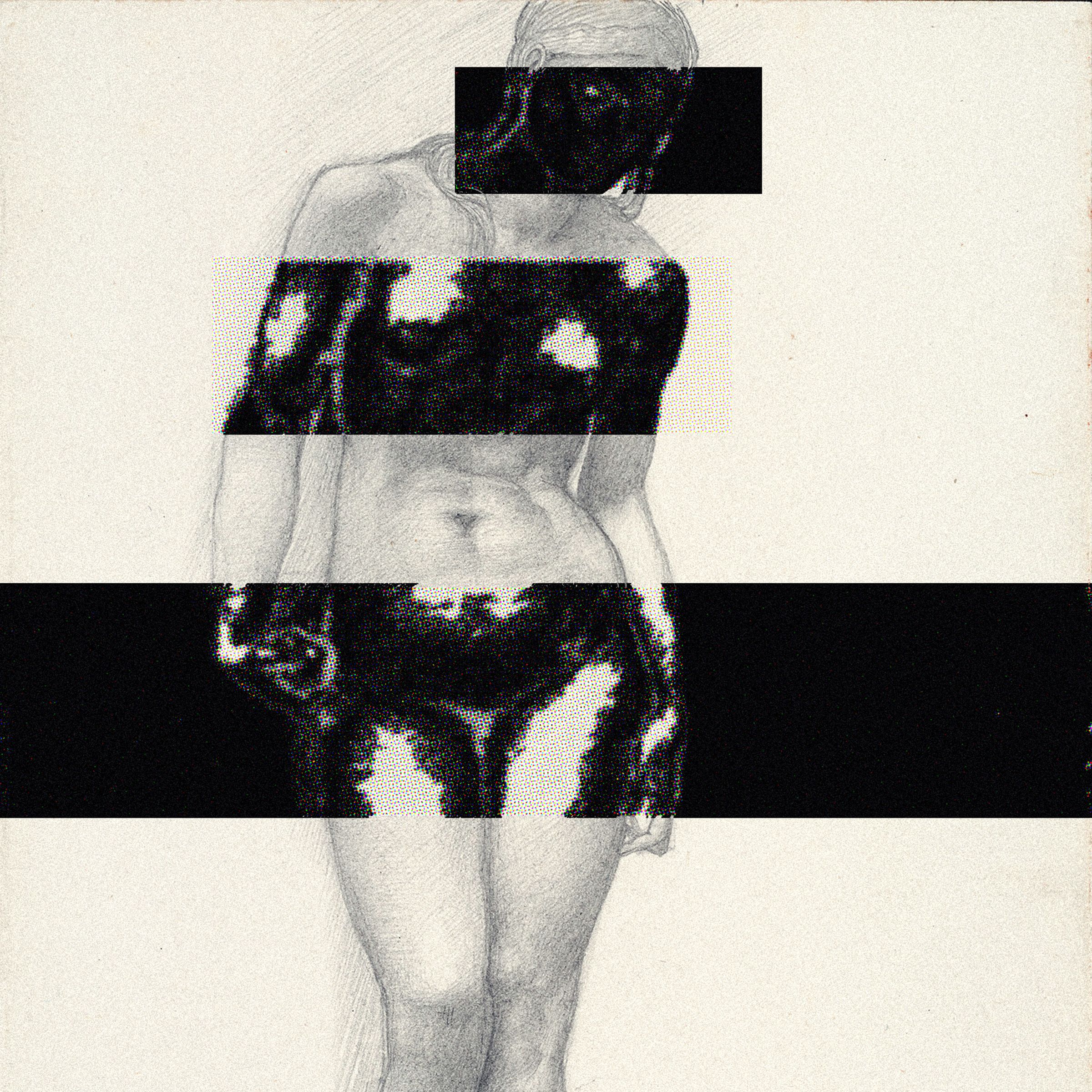

"La exposición de millones de imágenes explícitas y videos generados con inteligencia artificial expone preocupantes vulnerabilidades en la seguridad en

Un startup de generación de imágenes con inteligencia artificial (IA) dejó más de 1 millón de imágenes y videos creadas con sus sistemas expuestas y accesibles a cualquier persona en línea, según un nuevo informe revisado por WIRED. La mayoría de las imágenes involucraban desnudez y eran "contenido adulto" depuesto, según el investigador que descubrió la exposición de datos, con algunas que parecían mostrar niños o las caras de niños intercambiadas en los cuerpos nudos de adultos.

**Análisis**

La exposición de más de 1 millón de imágenes y videos generados con IA es un problema grave que requiere una acción inmediata. La creación de contenido explicito sin el consentimiento de las personas involucradas es inaceptable y puede generar daño grave a las víctimas. La industria de la IA-image generation debe tomar medidas para garantizar la seguridad y privacidad de los datos, y no permitir que sus herramientas sean utilizadas para crear contenido explícito sin consentimiento.

La falta de moderación en algunas de estas plataformas es un problema grave que puede ser utilizado por criminales para crear contenido explícito infantil o de abuso sexual. Es imperativo que las empresas involucradas tomen medidas para detectar y eliminar este tipo de contenido, y no permitir que sus herramientas sean utilizadas para crear contenido explícito sin consentimiento.

La sociedad debe tomar medidas para proteger a los niños y a las personas adultas de la creación y difusión de contenido explícito. Es importante que nos sintamos comprometidos con la lucha contra el abuso sexual infantil y que trabajemos juntos para crear un entorno más seguro para todos.